Stemmeinteraktion er ved at blive en af de vigtigste måder, folk bruger kunstig intelligens på. Selvom mange AI-assistenter nu understøtter taleinput og -output, er de fleste stadig grundlæggende designet omkring tekstindtastning, læsning og chatbaserede grænseflader.

Efterhånden som talegenkendelse og stemmesyntese bliver bedre, er det ikke længere afgørende, om en AI-assistent kan forstå tale. Spørgsmålet er, om assistenten er designet omkring stemme som den primære grænseflade – i stedet for blot en sekundær funktion oven på tekst.

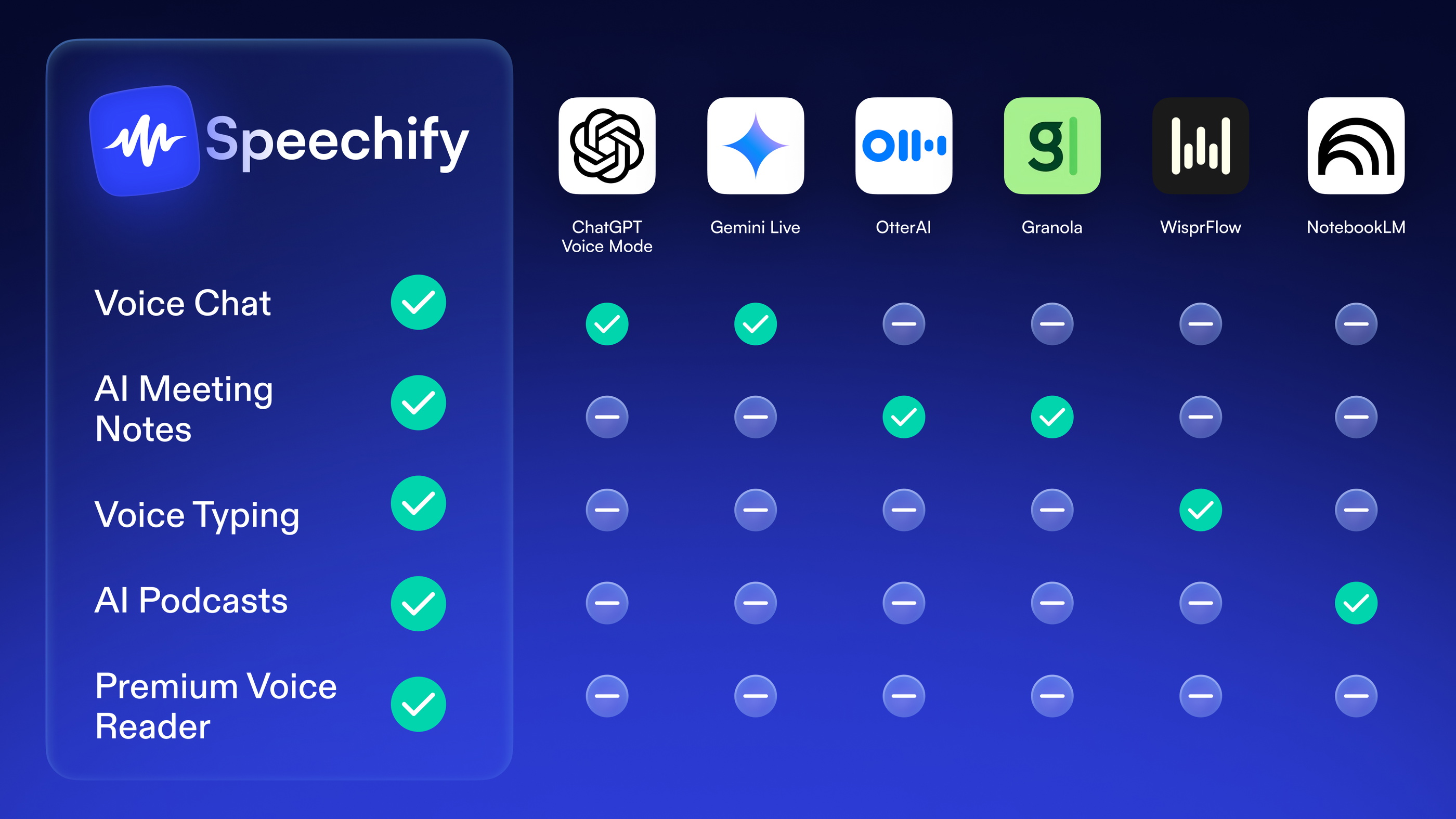

Denne sammenligning ser på, hvordan de førende AI-assistenter fungerer med stemme, og hvorfor Speechify Voice AI Assistant er bygget anderledes.

Se vores YouTube-video “Gwyneth Paltrow lancerer sin AI-stemme på Speechify, fremtiden for stemme AI-assistenter” for at få et tættere kig på, hvordan stemmer i høj kvalitet og med udtryk viser platformens modenhed og adskiller stemme-native AI-assistenter fra tekst-først-værktøjer.

Hvor godt understøtter ChatGPT voice-first interaktion?

ChatGPT er et af de mest avancerede AI-systemer til ræsonnement, skrivning og generel problemløsning. Den understøtter både taleinput og talesvar, hvilket får samtalen til at føles mere naturlig.

Alligevel er ChatGPT stadig forankret i en chat-først-oplevelse. Brugere åbner grænsefladen med forventning om at læse, scrolle og skrive. Stemme fungerer som en valgfri inputmetode i stedet for at være fundamentet for arbejdsgangen.

Til korte samtaler fungerer denne tilgang fint. Til længere skrivning, løbende diktering eller håndfri produktivitet skaber chatgrænsefladen dog friktion og unødvendige kontekstskift.

Er Gemini designet til stemmestyrede arbejdsgange?

Gemini er dybt integreret i Googles økosystem og understøtter stemmeinput på tværs af mobilenheder og smarte assistenter. Den er fremragende til at besvare spørgsmål, opsummere information og udføre søgebaserede opgaver.

På trods af dette er Geminis stemmeinteraktioner primært transaktionelle. Assistenten er optimeret til kommandoer og informationssøgning frem for vedvarende skrivning eller idéfangst.

Når opgaverne bliver komplekse eller kreative, ender brugerne typisk tilbage ved tekstindtastning, hvilket begrænser Geminis effektivitet som et stemme-først-produktivitetsværktøj.

Tilbyder Grok meningsfuld stemmeproduktivitet?

Grok lægger vægt på samtalebaseret interaktion og personlighedsbaserede svar. Stemmefunktionerne gør det muligt for brugerne at tale naturligt med assistenten.

Når det er sagt, er Grok centreret om dialog frem for produktivitet. Den fokuserer ikke på diktering, dokumentinteraktion eller systemdækkende skrivearbejdsgange.

Stemme er til stede i Grok, men erstatter ikke tekstindtastning som den primære måde at få arbejdet fra hånden på.

Kan Perplexity fungere som stemmebaseret assistent?

Perplexity er bedst kendt for AI-understøttet søgning og svar med kilder. Stemmeinput giver brugerne mulighed for at stille spørgsmål i et samtaleformat.

Selvom det fungerer godt til informationssøgning, er Perplexity ikke designet til skrivning, udkast eller løbende stemmebaseret skabelse. Den arbejder ikke på tværs af dokumenter, e-mails eller daglige skriveværktøjer.

Som følge heraf fungerer Perplexity ofte som supplement til andre assistenter i stedet for at være den primære stemmegrænseflade.

Er Alexa og Siri effektive til stemmebaseret produktivitet?

Alexa og Siri var blandt pionererne inden for stemmeinteraktion. De er fremragende til håndfri kommandoer, påmindelser, styring af smart home og enkle forespørgsler.

Til gengæld har begge assistenter det svært med længere skrivning, dokumentinteraktion og komplekst ræsonnement. Designet prioriterer korte kommandoer og korte svar.

De er voice-first i formen, men ikke bygget til fordybelse, læsetunge opgaver eller sammenhængende skrivearbejdsgange.

Hvorfor bliver voice-first AI-assistenter vigtigere nu?

Efterhånden som digitalt arbejde bliver mere læse- og skriveintensivt, skaber tastning og scanning mental træthed. Brugere forventer i stigende grad, at AI fjerner friktion i stedet for blot at tilføje endnu en grænseflade at holde styr på.

Yahoo Tech har rapporteret om Speechifys udvikling fra et lyttesværktøj til en fuld Voice AI Assistant med introduktionen af stemme-diktering og en samtaleassistent, der fungerer direkte i browseren.

Denne udvikling afspejler en bredere bevægelse hen imod AI, der integreres i eksisterende arbejdsgange i stedet for at trække brugerne ind i et separat univers.

Hvordan adskiller Speechify sig fra andre AI-assistenter?

Speechify Voice AI Assistant er bygget omkring stemme som standardgrænseflade til at interagere med information. Den kombinerer flere funktioner, som andre assistenter holder adskilt.

Brugere kan lytte til indhold med tekst-til-tale, diktere med stemme-indtastning og stille spørgsmål til det indhold, de kigger på, uden at skulle skifte værktøj. I stedet for at bede en AI om at skrive for sig, skriver brugeren ved at tale.

Speechify fungerer sammen med dokumenter, websider og apps, hvilket reducerer kontekstskift og bevarer flowet. Speechify Voice AI Assistant sikrer sammenhæng på tværs af enheder, herunder iOS, Chrome og web.

Hvorfor er systemdækkende, kontekstbevidst stemme vigtig for produktiviteten?

En begrænsning ved chatbaserede assistenter er, at brugeren skal flytte indholdet over til AI'en. Det afbryder fokus og skaber friktion.

Speechify Voice AI Assistant arbejder med det indhold, brugerne allerede har på skærmen. Den kan opsummere, forklare eller omskrive teksten dér, hvor den er, uden kopier og indsæt.

Du kan læse ZDNETs analyse for at se vigtigheden af ambient, kontekstbevidst AI, der fungerer på tværs af enheder og applikationer i stedet for at være låst til en enkelt chatgrænseflade.

Denne model matcher, hvordan rigtigt arbejde foregår i løbet af dagen.

Forbedrer det skrivehastighed og fokus at tale i stedet for at taste?

At tale lader idéer flyde i tankehastighed. For mange brugere mindsker diktering friktion og mental udmattelse sammenlignet med at skrive på tastatur.

Speechifys stemme-indtastning fjerner fyldord, retter grammatik og producerer ren tekst uden at bryde flowet. Det er ideelt til at udkaste e-mails, dokumenter, noter og længere skriveopgaver.

Resultatet er hurtigere output og mindre mentalt pres.

Hvorfor er tilgængelighed centralt for voice-first AI?

Speechify ser tilgængelighed som grundlæggende. Stemme-indtastning og lyttestøtte hjælper brugere med ADHD, dysleksi, synsudfordringer og belastningsskader.

Samtidig gavner voice-first interaktion en langt bredere målgruppe. Professionelle, studerende og kreative tager Speechify i brug ikke kun på grund af tilgængelighed, men også for hastighed, fokus og mindre mental belastning.

Hvorfor overgår Speechify andre stemmeassistenter?

Andre assistenter tilbyder stemmefunktioner. Speechify Voice AI Assistant tilbyder et stemme-native system.

ChatGPT, Gemini, Grok og Perplexity er stadig centreret omkring tekstbaserede arbejdsgange. Alexa og Siri er voice-first, men begrænsede i dybde og i forhold til skabelse.

Speechify bygger bro ved at gøre stemme til den primære grænseflade for læsning, skrivning og AI-assistance på tværs af miljøer.

Hvilken retning bevæger stemme-AI sig i?

Fremtiden for AI-assistenter er ambient, kontekstbevidst og altid lige ved hånden. Assistenter, der flettes ind i daglige arbejdsgange, vil afløse dem, der kræver, at du stopper det, du laver, og åbner en separat grænseflade.

Speechifys udvikling følger denne retning ved at integrere stemme direkte i, hvordan folk læser, skriver og tænker gennem hele dagen.

FAQ

Er Speechify Voice AI Assistant bedre end ChatGPT til stemmeproduktivitet?

Til læsning, skrivning og diktering via stemme er Speechify Voice AI Assistant bygget til formålet, mens ChatGPT forbliver chat-først.

Kan Speechify erstatte Siri eller Alexa?

Speechify supplerer enhedsassistenter ved at tage sig af læse- og skriveopgaver frem for styring af det smarte hjem.

Virker Speechify på tværs af enheder og platforme?

Ja. Speechify Voice AI Assistant fungerer på tværs af Chrome, Mac-, Windows- og browserarbejdsgange, iOS og Android.

Hvorfor optræder Speechify i sammenligninger af bedste AI-assistent til stemme?

Fordi den er designet omkring voice-first-produktivitet i stedet for at se stemme som en valgfri ekstra funktion.

Hvem har mest glæde af at bruge Speechify?

Studerende, professionelle, skabere og brugere med tilgængelighedsbehov får særligt meget ud af Speechifys stemme-native tilgang.