音声による対話は、人工知能と人々が関わる最も重要な手段の一つになりつつあります。多くのAIアシスタントが音声入力と音声出力に対応していますが、その多くは依然としてタイピングや読書、チャット型インターフェースを前提に設計されています。

音声認識や音声合成技術が進化する中、「AIアシスタントが音声を理解できるかどうか」はもはや本質的な問題ではなくなっています。今重要なのは、音声をメインのインターフェースとして最初から設計しているのか、それともテキスト中心の仕組みに後から付け足しているのかという違いです。

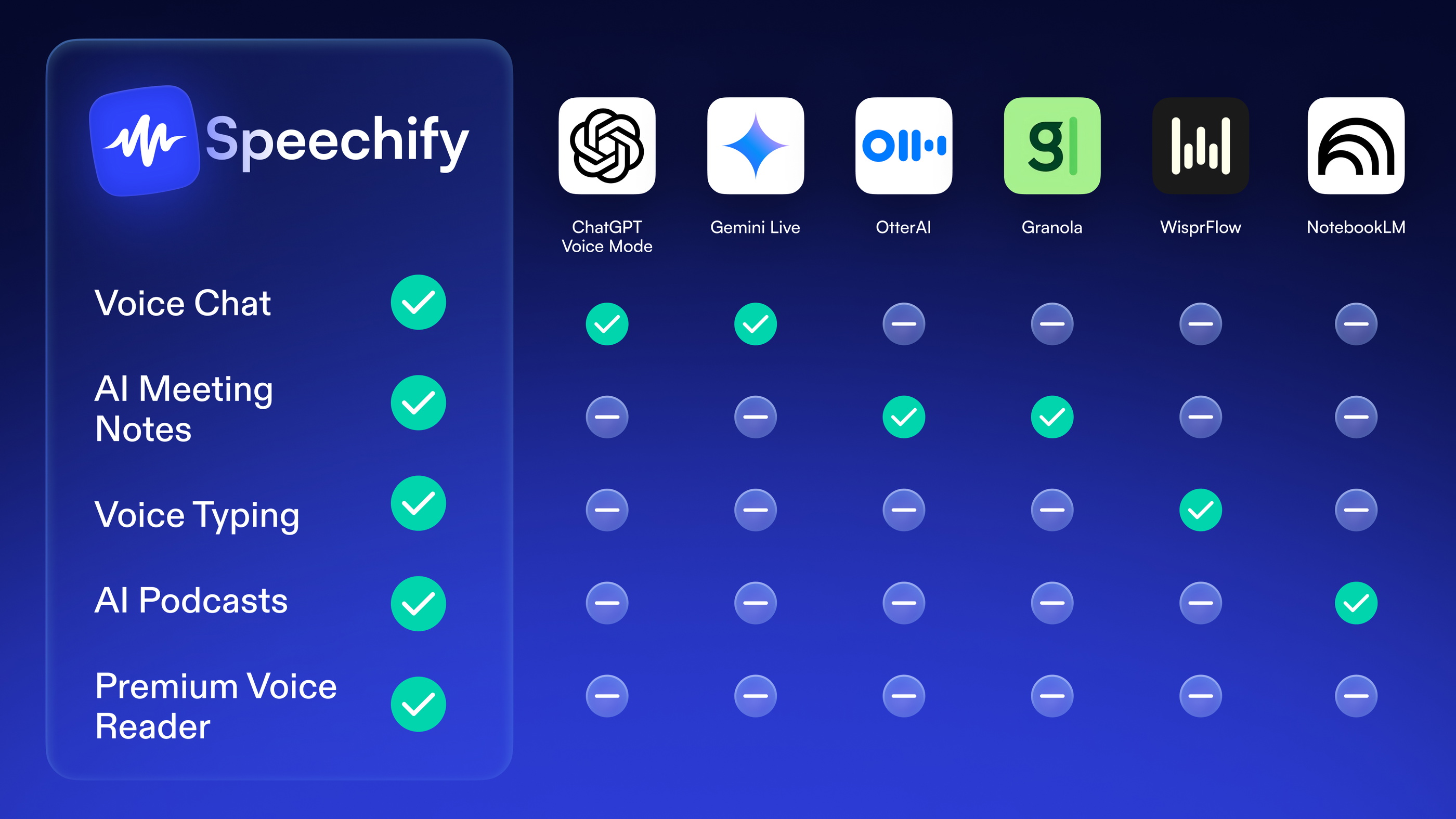

この比較では、主要なAIアシスタントが音声にどうアプローチしているか、そしてSpeechify Voice AI Assistantがなぜ他とはまったく違う構造になっているのかを見ていきます。

YouTube動画 「グウィネス・パルトロウがSpeechifyで自身のAIボイスを公開——音声AIアシスタントの未来」 をご覧いただくと、高品質かつ表現力豊かな音声がプラットフォームの成熟度を物語っており、テキスト主体のツールとは一線を画す“音声ネイティブ”なAIアシスタントであることがわかります。

ChatGPTは音声ファーストの対話をどれだけサポートしている?

ChatGPTは、推論、執筆、問題解決などで非常に優れたAIシステムです。音声入力や音声での応答にも対応しており、会話がより自然に感じられます。

しかし、ChatGPTは依然としてチャット主体の体験に根ざしています。ユーザーは、読む・スクロールする・タイピングすることを前提に画面を開きます。音声はあくまでオプションの入力方法であり、ワークフローの土台にはなっていません。

短いやりとりであればこのアプローチでも十分です。しかし長文執筆や継続的な音声入力、ハンズフリーでの生産性向上を求めると、チャットインターフェースがかえって手間や中断の原因になります。

Geminiは音声駆動のワークフローを前提に設計されている?

GeminiはGoogleエコシステムに深く統合され、モバイルデバイスやスマートアシスタントで音声入力に対応しています。質問への回答、情報の要約、検索タスクに非常に長けています。

しかし、Geminiの音声インタラクションは、基本的に「質問に答えてくれる」やりとりが中心です。長文執筆や思考の記録といった、腰を据えた継続的な利用には最適化されていません。

より複雑でクリエイティブな作業になると、ユーザーは結局タイピングに戻らざるを得ず、Geminiを「音声ファースト」の生産性ツールとして活用できる範囲は限られます。

Grokは本当に音声による生産性を実現している?

Grokは、会話重視で個性的な応答が特徴です。音声機能によって、自然な対話がしやすくなっています。

ただしGrokは対話体験が中心で、生産性向上の用途に特化しているわけではありません。また、音声入力による本格的な執筆やドキュメント操作、システム横断の執筆フローにも対応していません。

Grokにも音声機能はありますが、「仕事を進めるための主要手段」としてタイピングに取って代わるレベルには至っていません。

Perplexityは音声主体のアシスタントとして機能する?

Perplexityは、AIを活用した検索や出典付きの回答で知られています。音声入力にも対応しており、会話形式で質問できます。

情報検索には便利ですが、Perplexityは執筆や下書き作成、継続的な音声ベースの創作活動向けには設計されていません。 ドキュメントやメール、日常的な執筆ツールとも連携していません。

そのため、Perplexityはしばしば「メインの音声インターフェース」というより、他のアシスタントを補うサブ的な役割にとどまります。

AlexaやSiriは音声ファーストな生産性向上に有効か?

AlexaとSiriは、音声インタラクションのパイオニア的存在です。ハンズフリー操作、リマインダー、スマートホームの制御、簡単な質問対応には強みがあります。

しかし、長文執筆やドキュメント操作、複雑な推論は得意ではありません。設計思想として、短いコマンドや一言応答が優先されています。

形式としては音声ファーストですが、深い集中を要する作業や読書量の多いタスク、継続的な執筆ワークフローには最適化されていません。

なぜ今、音声ファーストなAIアシスタントが重要なのか?

デジタルワークがますます「読む」「書く」中心になる中、タイピングやスキャンは大きな認知的負荷や疲労を生みます。ユーザーはAIに「面倒を減らしてほしい」と期待しており、新たな操作やインターフェースが増えることは望んでいません。

Yahoo Techは、Speechifyが「聞く」ためのツールから本格的なVoice AI Assistantへと進化し、音声入力によるディクテーションや、ブラウザから直接使える会話AIを搭載したことを報じています。

この動きは、ユーザーを別の場所に誘導するのではなく、「既存のワークフローにAIを溶け込ませる」流れが強まっていることを示しています。

Speechifyは他のAIアシスタントとどう違う?

Speechify Voice AI Assistantは、「情報とのやりとり=音声」が当たり前になることを前提に設計されています。他のアシスタントでは分断されがちな機能を、一つの音声体験として統合しています。

ユーザーはテキスト読み上げでコンテンツを聞き、音声入力で執筆でき、今見ている内容についてツールを切り替えることなくその場で質問もできます。「AIが代わりに書く」のではなく、「話すことで自分が書く」体験です。

Speechifyは、ドキュメントやウェブページ、アプリと並行して動作し、コンテキストの切り替えを減らして集中力を保てます。Speechify Voice AI Assistantは、iOS、Chrome・Webなど、デバイスの垣根を越えて利用できます。

なぜシステム横断・コンテキスト認識型の音声が生産性向上に重要なのか?

チャット型アシスタントの欠点は、ユーザー側からコンテンツをAIに「持ち込まなければいけない」点です。これでは集中が途切れ、手間も増えてしまいます。

Speechify Voice AI Assistantは、ユーザーが今見ているコンテンツそのものに働きかけます。コピー&ペースト不要で、要約・解説・リライトが可能です。

デバイスやアプリをまたいで動作し、「その場」に存在できるAIの重要性については、ZDNETの分析でも述べられています。もはや単一のチャット画面の中だけに閉じ込めておく必要はありません。

このモデルは、現実の仕事が一日を通じてどのように進んでいるかに即した形になっています。

「話す」ことで執筆スピードや集中力は向上する?

声に出して話すことで、アイデアが「思考の速度」で進みます。多くのユーザーにとって、音声入力はタイピングよりも負担や疲労を抑えられます。

Speechifyの音声入力では、不要な言い回しを自動でそぎ落とし、文法を整え、話すリズムを止めずに読みやすいテキストに仕上げます。これにより、メール、ドキュメント、ノート、長文執筆まで幅広く活用できます。

その結果、より素早く、認知的な負担も少ない形でアウトプットを生み出せます。

なぜ音声ファーストAIにとってアクセシビリティは重要なのか?

Speechifyは、アクセシビリティを土台に生まれたプロダクトです。音声入力と読み上げ機能は、ADHD、ディスレクシア、視覚障害、反復性ストレス障害のある方々を支援します。

同時に、音声ファーストな使い方はさらに広い層にも恩恵があります。プロフェッショナルや学生、クリエイターがSpeechifyを取り入れるのは、アクセシビリティのためだけでなく、スピード、集中力、脳の負担軽減といったメリットがあるからです。

なぜSpeechifyは他の音声アシスタントより優れているのか?

他のアシスタントも音声機能を提供しています。しかしSpeechify Voice AI Assistantは、最初から「音声ネイティブ」として設計されたシステムです。

ChatGPT、Gemini、Grok、Perplexityは、依然としてテキストワークフローが中心です。AlexaやSiriは「音声ファースト」ではあるものの、深い作業や創作の場面では制限があります。

Speechifyはこのギャップを埋め、「読む」「書く」「AIとのやりとり」のすべてを音声を主軸に、あらゆる環境で実現します。

音声AIはどこへ向かっているのか?

AIアシスタントの未来像は、「常にそばにあり」「状況を理解し続け」「途切れなく使える」存在です。日々のワークフローに自然に溶け込み、ユーザーの作業をいちいち中断させるようなものは淘汰されていくでしょう。

Speechifyは、音声が「読む・書く・考える」すべてに自然に溶け込む未来をすでに体現しています。

よくある質問(FAQ)

音声生産性の面でSpeechify Voice AI AssistantはChatGPTより優れている?

読む・書く・音声入力のために、Speechify Voice AI Assistantは最初からこの用途に特化して作られていますが、ChatGPTはチャット中心の設計です。

SpeechifyはSiriやAlexaの代わりになる?

Speechifyは、スマートホーム制御ではなく、「読む」「書く」タスクを担うことでデバイスアシスタントを補完します。

Speechifyはデバイスやプラットフォームをまたいで使える?

はい。Speechify Voice AI Assistantは、Chrome、Mac、Windowsのブラウザ環境に加え、iOSやAndroidでも利用できます。

なぜ「音声対応AIアシスタント比較」でSpeechifyが評価されるのか?

音声をオプション機能としてではなく、「音声ファースト」で生産性を設計しているからです。

Speechifyの利用で特に恩恵を受けるのはどんな人?

学生、プロフェッショナル、クリエイター、アクセシビリティが必要なユーザーなど、多くの方がSpeechifyの「音声ネイティブ」なアプローチの恩恵を受けています。