Introduktion til OpenAI Whisper

Whisper-modellen er et open-source automatisk talegenkendelsessystem (ASR) udviklet af OpenAI. Det er designet til at håndtere en række tale-til-tekst opgaver, herunder transskribering af podcasts, konvertering af talte dialoger til skriftlig tekst og endda taleoversættelse. Takket være træning på et mangfoldigt datasæt understøtter det flere sprog, selvom dets ydeevne på engelsk er særligt bemærkelsesværdig.

Nøglefunktioner i Whisper API

- Høj Nøjagtighed: Whisper tilbyder en lav fejlrate (WER) takket være omfattende træning på en bred vifte af lydfiler.

- Flersproget Support: Selvom det er optimeret til engelsk, understøtter API'en flere sprog, hvilket gør det alsidigt til globale applikationer.

- Realtids Transskribering: Med GPU-support, især fra NVIDIA, kan API'en transskribere lyd i realtid, hvilket er ideelt til applikationer som live-udsendelser.

- Fleksibilitet med Lydformater: API'en kan behandle forskellige lydfilformater, herunder WAV og WEBM.

Opsætning af Whisper API

For at komme i gang med at bruge Whisper skal du typisk installere API'en via pip:

```bash

pip install openai-whisper

```

Når den er installeret, er det ligetil at bruge Whisper i et Python-script. Her er en hurtig vejledning i, hvordan man transskriberer en WAV-fil:

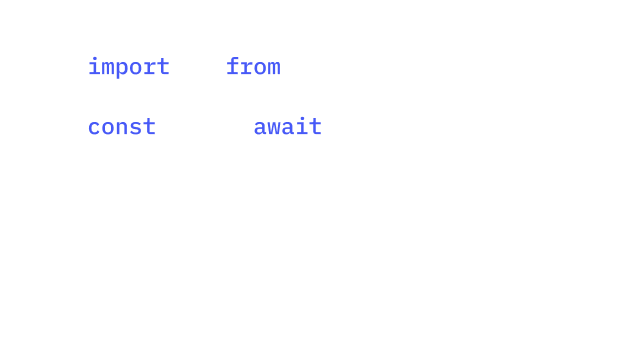

```python

import whisper

model = whisper.load_model("base") # eller vælg en anden modelstørrelse afhængigt af dine behov

result = model.transcribe("path_to_your_audio_file.wav")

print(result['text'])

```

Dette script vil indlæse Whisper-modellen, transskribere lydfilen og udskrive transskriptionen. Det giver også tidsstempler og anden metadata i JSON-outputtet, hvilket kan være meget nyttigt til detaljeret analyse.

Whisper API Prissætning og Hostingmuligheder

Whisper API kan hostes på flere måder:

- Selv-Hosted: Du kan hoste Whisper på dine egne servere. Dette er fordelagtigt, hvis du har bekymringer om databeskyttelse, eller hvis du regelmæssigt skal transskribere store mængder lyddata. Det kræver mere opsætning og administration, men giver fuld kontrol over transskriptionsmiljøet.

- Cloud Services: Du kan implementere Whisper på cloud-platforme som Azure. Dette forenkler ofte opsætningsprocessen og giver skalerbare ressourcer efter behov.

OpenAI opkræver i øjeblikket ikke betaling for at bruge Whisper direkte, da det er open-source, men husk omkostningerne forbundet med server- eller cloud-tjenestebrug, især hvis du har brug for GPU'er til realtids transskribering.

Anvendelsestilfælde

De praktiske anvendelser af Whisper API er mange:

- Uddannelsesplatforme: Transskriber forelæsninger og undervisning for bedre tilgængelighed.

- Juridiske og Medicinske Felter: Præcis transskription af retsmøder og konsultationer.

- Medier og Underholdning: Undertekstning og oversættelse af indhold til internationale publikum.

- Podcasts og Interviews: Konverter nemt tale til søgbar tekst.

Udvidelse af Whisper API

For dem, der ønsker at finjustere Whisper-modellen til specifikke behov, er den open-source natur af API'en en stor fordel. Du kan træne modellen på specifikke datasæt for at forbedre dens nøjagtighed på nicheordforråd eller accenter. Derudover kan Docker bruges til at containerisere Whisper-miljøet, hvilket gør det lettere at implementere på tværs af forskellige systemer.

OpenAI Whisper API er et kraftfuldt værktøj for alle, der har brug for effektive og præcise tale-til-tekst tjenester. Med sin brugervenlighed, understøttelse af flere sprog og fleksibilitet i hosting, skiller Whisper sig ud som en førende løsning inden for talegenkendelse. Uanset om det er til individuelle projekter eller store virksomheders behov, kan Whisper opfylde en bred vifte af transskriptionsbehov. For mere detaljeret dokumentation og fællesskabsstøtte, besøg projektets GitHub-side på github.com/openai/whisper.

Efterhånden som teknologien fortsætter med at udvikle sig, vil værktøjer som Whisper API spille en afgørende rolle i, hvordan vi interagerer med og behandler talt information. Dyk ned i dokumentationen, eksperimenter med koden, og udforsk, hvordan Whisper kan forbedre dine projekter eller forretningsdrift.

Ofte Stillede Spørgsmål

Du kan hoste Whisper på dine egne servere eller implementere det på cloud-platforme som Azure, ved at bruge de nødvendige afhængigheder og sikre, at det opfylder dine krav.

Ja, Whisper er open-source og kan bruges gratis, men hosting på servere eller cloud-platforme kan medføre omkostninger.

Selvom OpenAI har udviklet Whisper, hoster de ikke Whisper API-endpoints direkte. Brugere skal selv hoste eller bruge cloud-tjenester.

Whisper API kan have begrænsninger med hensyn til sprognøjagtighed uden for engelsk, afhængighed af GPU til realtidsbehandling, og overholdelse af OpenAI's vilkår, især ved brug af en OpenAI API-nøgle til relaterede tjenester som ChatGPT eller LLM'er som GPT-3.5 og GPT-4.